ICASSP (International Conference on Acoustics, Speech and Signal Processing) 即国际声学、语音与信号处理会议,是IEEE主办的全世界最大的,也是最全面的信号处理及其应用方面的顶级会议,在国际上享有盛誉并具有广泛的学术影响力。我校计算机学院(软件学院)“语音理解与生成研究组”(刘瑞研究员团队)和“语音信号处理组”(张学良教授团队)共有3篇论文被ICASSP2023录用,以下为论文简述。

Paper 01

EXPLOITING MODALITY-INVARIANT FEATURE FOR ROBUST MULTIMODAL EMOTION

RECOGNITION WITH MISSING MODALITIES

作者:左昊麟1,刘瑞1*,赵金明2,高光来1,李海洲3

单位:1 内蒙古大学,2 启元实验室,北京,3 香港中文大学(深圳校区)

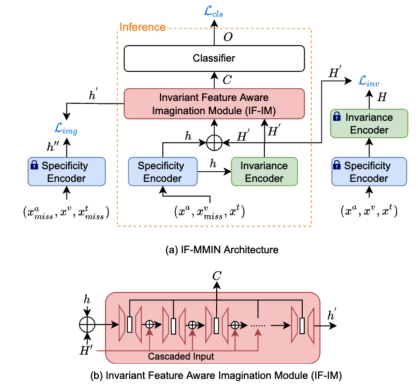

多模态情感识别利用跨模态的互补信息实现多模态融合。但是,在实际场景中,模态缺失问题普遍存在。在进行缺失模态预测时,不同模态之间的固有差异(Modality Gap)带来了很大挑战。为了解决这个问题,我们模拟人类的多模态隐含信息推理能力,提出将模态不变特征用于缺失模态想象网络(IF-MMIN),其中包括两种创新机制:1)基于全模态场景下CMD距离的模态不变特征学习策略;2)融合不变特征的缺失模态想象模块(IF-IM),以减轻缺失模态预测期间的Modality Gap问题,从而改善了多模态联合特征表示的鲁棒性。基准数据集IEMOCAP上的实验表明,所提出的模型优于所有基线方法,并且显著改善了不确定缺失模态条件下的整体情感识别性能。我们将代码发布在以下网址:https://github.com/ZhuoYulang/IF-MMIN。

Paper 02

ICCRN: INPLACE CEPSTRAL CONVOLUTIONAL RECURRENT NEURAL NETWORK FOR MONAURAL SPEECH ENHANCEMENT

作者:刘晋江,张学良

单位:内蒙古大学

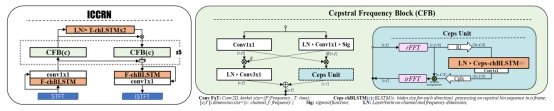

根据语音产生的机理,声道将缓慢变化的语义信息调制到声带发出的宽带载波上,这在频谱上分别表现为包络和谐波结构,它们在倒谱域中可以被更稀疏地表示。基于这一机制,我们提出了一种在时频倒谱空间中进行联合降噪的倒谱频率增强模块(CFB)。该方法不使用倒谱作为输入特征,而是隐式的实现频域特征和倒谱空间的相互变换,并在时频域和倒谱空间进行联合增强。最终我们将该CFB模块整合到了我们之前的原地卷积循环网络(ICRN)中,成功的将该模型的适用场景从多通道拓展到了单通道场景。实验结果表明,提出的ICCRN模型显著优于基线系统,并且在谐波结构增强方面具有独特优势。

Paper 03

SPEECH ENHANCEMENT WITH INTELLIGENT NEURAL HOMOMORPHIC SYNTHESIS

作者:何树林1 , 饶为2 , 刘晋江1 , 陈鋆2 , 琚雨恺2 , 张学良1 , 王燕南2 , 商世东2

单位:1内蒙古大学,2腾讯天籁实验室

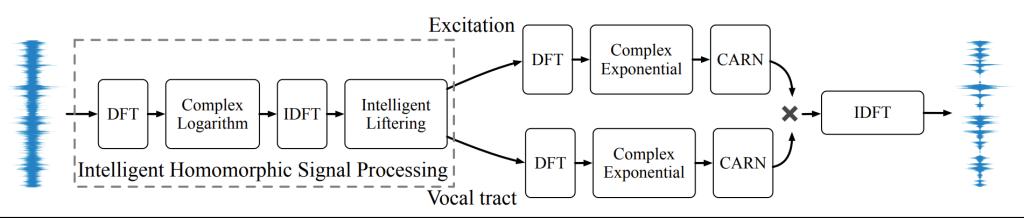

大多数基于神经网络的语音增强方法选择直接映射傅里叶变换域频谱或波形,从而忽略语音产生的数学模型,限制了语音增强的性能。在这项工作中,我们提出了一种用于语音增强的神经源-滤波器网络。具体来说,我们使用同态信号处理和倒谱分析来获得带噪语音的激励和声道,与传统信号处理的方法不同,我们使用注意递归网络(ARN)模型预测比率掩码来代替提升分离函数。然后,分别使用两个卷积注意递归网络(CARN)来预测干净语音的激励和声道。系统的输出由估计的激励和声音合成。实验证明,我们提出的方法性能更好,与FullSubNet相比,SI-SNR提高了1.363dB。

来源:计算机学院(软件学院)

![]() 蒙ICP16002391号-1

蒙ICP16002391号-1